23年初大模型刚刚兴起的时候,买了一本Stephen Wolfram的书:《这就是ChatGPT》(This is ChatGPT,2023),看完就基本明白了ChatGPT的工作原理,用生成来增强学习,其本质在于学习而不是生成,但是大家都更喜欢生成功能。后来同事YG推荐了另外一本书《人工智能时代》(The Age of A.I. And Our Human Future ,2021)。此书的作者有些意思:第一个是亨利•基辛格(Henry Kissinger),就是推动中美建交的那个国务卿,现在是个快100的老头了;第二个是埃里克•施密特(Eric Schmidt),是Alphabet 的前任董事长,现任SCSP美国政策和安全智库的主席,SCSP是个美国智库,有很强的政治意味;第三个是丹尼尔•胡滕洛赫尔(Daniel Huttenlocher),是康奈尔理工学院院长和创始人,只有最后这位是AI科学家,前面两位都涉及到国际政治。所以这本书也许并不那么简单。

The Special Competitive Studies Project (SCSP) is a non-partisan U.S. think tank and private foundation focused on technology and security. Founded by former Google CEO Eric Schmidt in October 2021,SCSP’s stated mission is to “make recommendations to strengthen America’s long-term competitiveness as artificial intelligence (AI) and other emerging technologies are reshaping our national security, economy, and society.” It seeks to ensure that “America is positioned and organized to win the techno-economic competition between now and 2030.”

本书目录如下:

前言 人工智能重塑人类社会秩序

第一章 我们的处境

第二章 何以至此:技术与人类思想的演变

第三章 从图灵到当下,以及未来

第四章 全球网络平台

第五章 安全与世界秩序

第六章 人工智能与人类身份

第七章 人工智能与未来

目录很简单,只有7个章节。我开始翻看时,确实大意了:以为就是一本宏观的AI技术书籍。前三章介绍的都是AI和大模型的发展历史、技术特征和没解决的问题,例如(1)AI很难被解释(2)AI不会反思(3)AI会犯低级错误并且有偏见(4)合规审计是AI面临的一个大问题(5)AI的演化问题(6)AI的算力消耗过大(7)AGI任重道远。这些问题有些是理论问题,但是可以通过工程手段缓解,有些短期没有解决方案,例如6和7。要是你以为接下来就分别研究这些问题,那就太天真了!

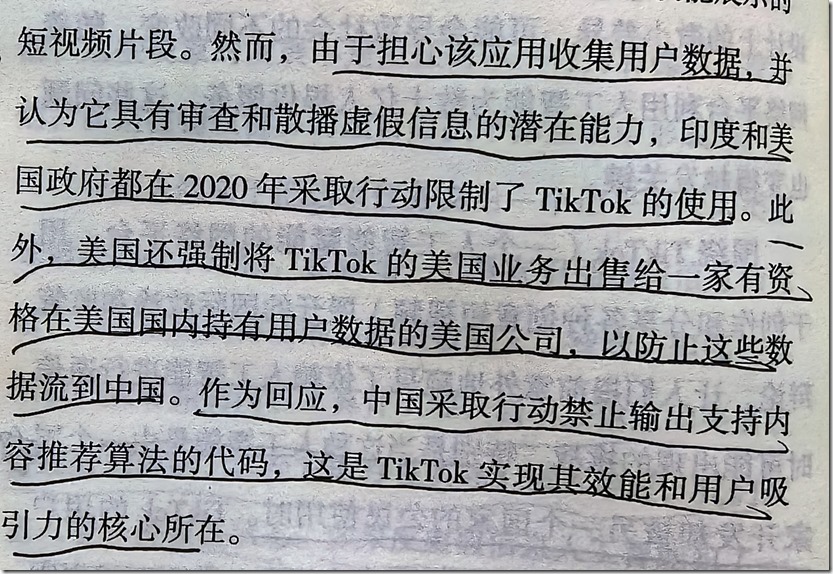

从第四部分开始,作者笔锋一转,开始讨论【网络平台】,通过【积极网络效应】阐述网络平台的正反馈效应、跨越国界和种族的力量,接着就提出了【人工智能赋能的网络平台】,并指出这个人工智能和前面说的有缺陷、可引导的人工智能是一个人工智能,因此【网络平台】有政治属性,源自运营者对人工智能的训练和数据。所以美国和印度限制了中国Tiktok平台的使用,而中国的反应侧面印证了他们的分析。最终的结论是:美国限制Tiktok的使用是合理的,而且要强制收购Tiktok。虽然美国政客2020年开始就提出限制使用Tiktok,但理论基础却源自2021年的这本书,也就是“中国人民老朋友”基辛格和“不作恶”的施密特联手策划的!而且还拉上印度来背书!

《人工智能时代》第四章相关内容节选:人工智能算法成为打击对象

2024年3月13日,美国众议院通过法案,要求字节跳动剥离对旗下短视频应用程序Tik Tok的控制权,否则Tik Tok将在美国遭到封禁!2023年和2024年,Tiktok总裁周受资(新加坡人)两次参加参议院听证会,舌战群魔!

周受资一人单挑这么多妖魔鬼怪,看表情,也是烦的够呛

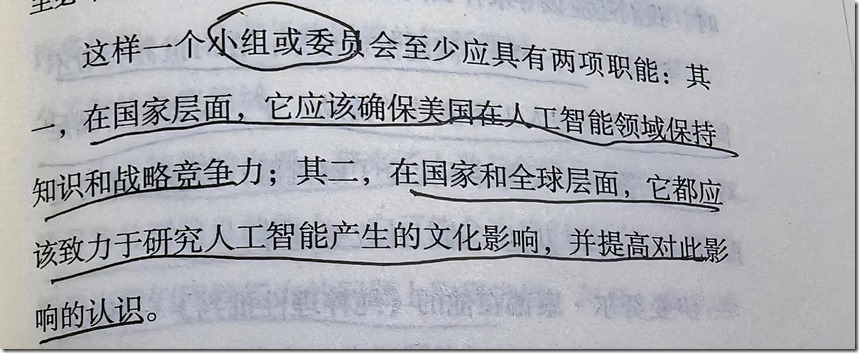

在飞回苏州的飞机上,看完了第五章,这章的主体是安全。用人工智能和核武器做了对比,核武器是众所周知的大杀器,为了帮中国撑起核保护伞,无数的科学家和军人还有工人一起在1964年首爆了原子弹,2年后爆炸氢弹,此后是核导弹、氢弹小型化、中子弹等一系列武器,有幸跟随父母经历了哪个火热的年代。这章回顾了国际上对核武器的关注历程,令人吃惊的是:人类创造了核武器,但是没有建立使用核武器的战略!这句话别人说出来,我是不信的。但是基辛格说出来,那就真是这样了!人工智能武器同样具有巨大的威力和不确定性,而且这是军民合用技术,几乎没有办法限制。说到这里,我就联想到了美国限制英伟达GPU的出口,这是一种遏制,有些类似限制离心机。但起不到禁止的作用,反而有可能刺激中国大力发展自有NPU和GPU技术,事实上也是如此,百模大战之前,百卡大战已经有些苗头。作者把人工智能武器分成两类,一类是辅助人类服务,一类的真的AI武器,美国目前大力发展第一种辅助型武器,而限制第二种。从新各种闻报道看,很难相信美国没有研制第二种武器。站在道德制高点上,确实需要考虑呼吁各国限制此类武器的研制,书中给出了6点政治建议,算是一个交代。

第六章和第七章也是在飞机上看的,在起飞的时候还是容易头晕犯困, 其他时候还是可以看看书。第六章分析了人工智能的身份问题,从决策、科学发现、教育、信息中介等众多方面,探讨人工智能和人的关系,整体来说,原先认为专属于人类的科学发明,人工智能也可以介入其中,例如AlphaFold大幅度提升了发现的速度。当然AI还是没有灵魂的存在,即不会反思,也不能产生可解释和识别的灵感。但是谁也不知道,如果孩子们是人工智能教会的,他们是不是就不会太在意这些不可解释的结果,而是泰然若之的接受人工智能的结果呢?第七章是更为深入,探讨了通用人工智能(AGI),这是一个目前人类目前远远不能企及的高度,如果人类还是要用GPU来构建AGI,则可能只有几个少数国家可以有一个AGI。AGI将是一个几乎无敌的存在:既可以做出不受情绪干扰的决策,还可以和网络武器结合起来,人类很难不受到AGI的影响,人如何对待AGI、与之相处,是一个哲学问题,而不是技术问题

相关信息:

https://blog.51cto.com/u_15767091/8294123

https://www2.shkp.org.cn/content.html?type=wx&id=435171

https://baijiahao.baidu.com/s?id=1793510052872775729&wfr=spider&for=pc

https://en.wikipedia.org/wiki/Daniel_Huttenlocher

https://en.wikipedia.org/wiki/Eric_Schmidt

https://en.wikipedia.org/wiki/Special_Competitive_Studies_Project